LLM模型参数配置

本页面用于为AILaw法律智能工作平台配置AI对话核心引擎,确保系统在案件处理、文书生成、卷宗分析等环节能稳定调用大语言模型能力。您可选择本地部署的Ollama模型(适合私有化部署场景)或阿里云百炼大模型服务(适合高并发、多模态需求),并精细调节模型行为参数。配置生效后,所有依赖AI的模块——如‘文档模板+AI’中的智能文书建议、‘个人知识库’的语义检索增强、以及‘工作台’的智能问答助手——都将基于此设置运行。

操作步骤

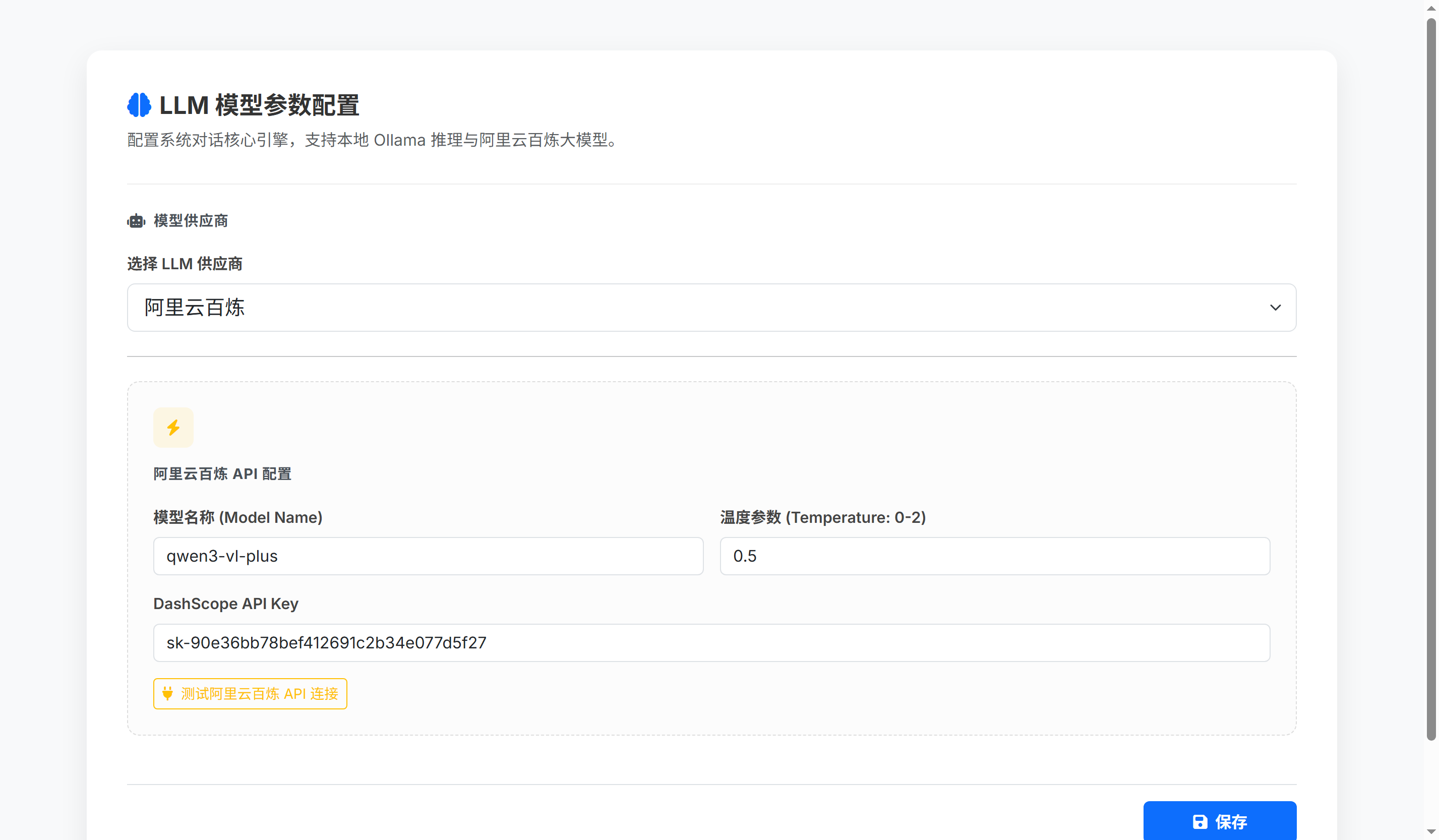

- 在‘模型供应商’下拉菜单中,点击当前显示为‘阿里云百炼’的选项框,确认已选中该服务商(若需切换为Ollama,请选择‘Ollama’并展开对应配置区)

- 在‘阿里云百炼 API 配置’区域中:① 在‘模型名称’输入框填写具体模型标识(如 qwen3-vl-plus);② 在‘温度参数’输入框输入0.0–2.0之间的数值(推荐0.3–0.7以平衡严谨性与创造性);③ 在‘DashScope API Key’输入框粘贴您从阿里云控制台获取的有效密钥(格式为sk-开头的32位字符串)

- 点击黄色按钮‘测试阿里云百炼 API 连接’,系统将实时验证网络连通性与密钥有效性;待提示‘连接成功’后,点击右下角蓝色‘保存’按钮提交全部配置

注意事项

本配置直接影响‘文档模板+AI’模块的文书生成质量与响应风格,也关联‘个人知识库’中向量检索后的语义重排逻辑;若后续启用‘远程扫描’模块的AI辅助证据摘要功能,同样依赖此处设定的模型能力。切换为Ollama时,需确保本地服务器已部署对应模型并开放API端口(默认http://localhost:11434),且模型名需与Ollama实际加载的标签严格一致;温度参数值越低(如0.1),AI输出越保守、事实性越强,适合法律文书校对;值越高(如1.5),越具发散性,适用于头脑风暴类场景。请勿将API Key截图或明文存储于非加密环境。

页面路径:http://127.0.0.1:18000/management/page/llm_configuration_management/